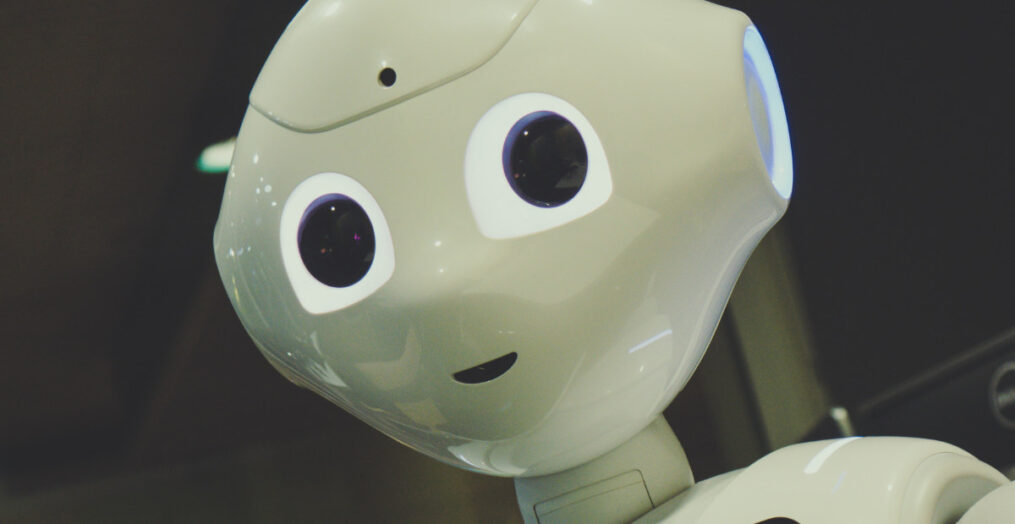

Yhteiskunnan toimintoihin mukaan ohjeilmoitu tekoäly vastaa useasta eri asiasta. Ihmisillä on kuitenkin vaikeuksia luottaa robotin valintoihin esimerkiksi tilanteissa, jossa tekoäly tekee päätöksen lääkkeestä ja ohittaa ihmisen oman tahdon – vaikka se saattaisi ollakin hänen omaksi parhaakseen.

Helsingin yliopiston tuoreessa tutkimuksessa selvitettiin sitä, miten ihmiset suhtautuvat hoitorobottien tekemiin päätöksiin. Tutkimuksen perusteella näyttää siltä, että tekoälysovelluksilta vaaditaan inhimillistä herkkyyttä ja empatiakykyä, jotta niiden tekemät ratkaisut ja päätökset tuntuisivat potilaista ja hoidettavista yhtä hyväksyttäviltä kuin ihmisten tekemät päätökset.

– Moraalipsykologisessa tutkimuksessa ei ole juurikaan käsitelty potilaan autonomiaa tai lääketieteen etiikan sisäisiä ristiriitoja – varsinkaan siitä näkökulmasta, että toimijana on robotti, tutkija Michael Laakasuo kertoo.

– Pakkolääkintää koskeva kysymyksenasettelu paljasti, että hoitorobotin ja ihmissairaanhoitajien tekemiä päätöksiä ei kohdella samanlaisina, vaikka ne olisivat seurauksiltaan identtisiä, Laakasuo sanoo.

– Huolestuttavin löydös oli kenties se, että kun tarinaa muutettiin niin, että potilas oli kuollut äkilliseen sairauskohtaukseen yön aikana, niin ihmisen koettiin olevan moraalisesti enemmän vastuussa potilaan kohtalosta kuin hoitorobotin, vaikka hoitopäätöksellä ja potilaan kuolemalla ei ollut mitään tekemistä toistensa kanssa.

Terveydenhuoltoala kärsii maailmanlaajuisesta hoitajapulasta. Tutkimuksen tulokset viittaisivat siihen suuntaan, että hoitajaresurssipulaa ei voida ongelmitta ratkaista koneiden avulla – ihmiset haluavat, että heitä edelleen hoitavat toiset ihmiset.